Pendant longtemps, l'accès à un modèle de langage performant impliquait une connexion à un service cloud — OpenAI, Anthropic, Google — avec les contraintes associées : coût à l'usage, dépendance à un fournisseur, transmission des données vers des serveurs tiers, et impossibilité de fonctionner hors connexion. Ollama change radicalement cette équation en rendant l'installation et l'exécution de grands modèles de langage (LLM) accessibles sur un ordinateur standard ou un serveur d'entreprise, en quelques minutes et sans expertise en data science.

Qu'est-ce qu'Ollama ?

Ollama est un outil open source qui permet de télécharger, gérer et exécuter des LLM localement. Son interface en ligne de commande est volontairement simple — elle s'inspire de Docker — et il expose une API HTTP compatible avec l'API d'OpenAI, ce qui facilite considérablement l'intégration dans des applications existantes.

Ollama prend en charge un catalogue croissant de modèles : Llama 3 (Meta), Mistral et Mixtral (Mistral AI), Gemma (Google), Phi-3 (Microsoft), Qwen (Alibaba), DeepSeek, et de nombreux modèles spécialisés (code, embedding, vision). Ces modèles sont distribués dans des formats quantifiés qui réduisent leur taille et leur consommation mémoire sans sacrifier l'essentiel de leurs capacités.

Installation et prise en main : une simplicité remarquable

L'installation d'Ollama se résume à une commande sur macOS et Linux, et à un installeur sur Windows. En quelques secondes, le service est opérationnel. Télécharger et lancer un modèle est tout aussi immédiat :

ollama pull mistral— télécharge le modèle Mistral 7B (~4 Go)ollama run mistral— ouvre une session de chat interactive dans le terminalollama serve— démarre l'API HTTP sur le port 11434

L'API REST exposée par Ollama est compatible avec le format de l'API OpenAI : les applications qui appellent https://api.openai.com/v1/chat/completions peuvent être redirigées vers http://localhost:11434/v1/chat/completions avec un changement de configuration minimal, sans toucher au code applicatif.

Les modèles disponibles et leurs cas d'usage

Le choix du modèle dépend des besoins et des contraintes matérielles :

- Llama 3.2 (3B / 8B) : excellent rapport qualité/ressources pour des tâches de raisonnement général, résumé, classification. Le modèle 8B tourne confortablement sur un ordinateur équipé de 16 Go de RAM.

- Mistral 7B / Mixtral 8x7B : très performants sur les tâches de génération de texte et d'instruction following. Mistral 7B est souvent cité comme le meilleur modèle de sa taille.

- CodeLlama / DeepSeek Coder : spécialisés dans la génération et l'analyse de code. Pertinents pour des outils d'aide au développement internes.

- Nomic Embed / mxbai-embed : modèles d'embedding pour la recherche sémantique et les architectures RAG (Retrieval-Augmented Generation), sans envoyer de données vers l'extérieur.

- Llava / Moondream : modèles multimodaux capables d'analyser des images en plus du texte.

Ce que cela change pour la confidentialité et la souveraineté des données

C'est probablement l'argument le plus structurant pour les organisations publiques et les entreprises traitant des données sensibles. Lorsqu'un agent utilise ChatGPT ou Claude pour rédiger un rapport, résumer une réunion ou analyser un document, le contenu de ce document transite vers les serveurs du fournisseur américain et entre dans son pipeline de traitement.

Avec Ollama déployé localement :

- Aucune donnée ne quitte le périmètre de l'organisation — ni le réseau local, ni a fortiori le territoire national.

- Conformité RGPD simplifiée : pas de transfert vers un pays tiers, pas de sous-traitant à référencer pour le traitement IA.

- Fonctionnement hors connexion : une fois le modèle téléchargé, l'inférence ne nécessite aucun accès à internet.

- Contrôle total du modèle utilisé : pas de mise à jour non désirée, pas de changement de comportement unilatéral de la part du fournisseur.

Pour une collectivité, un hôpital, un cabinet d'avocats ou tout organisme manipulant des informations protégées (données personnelles, données médicales, secret professionnel), ces garanties sont déterminantes.

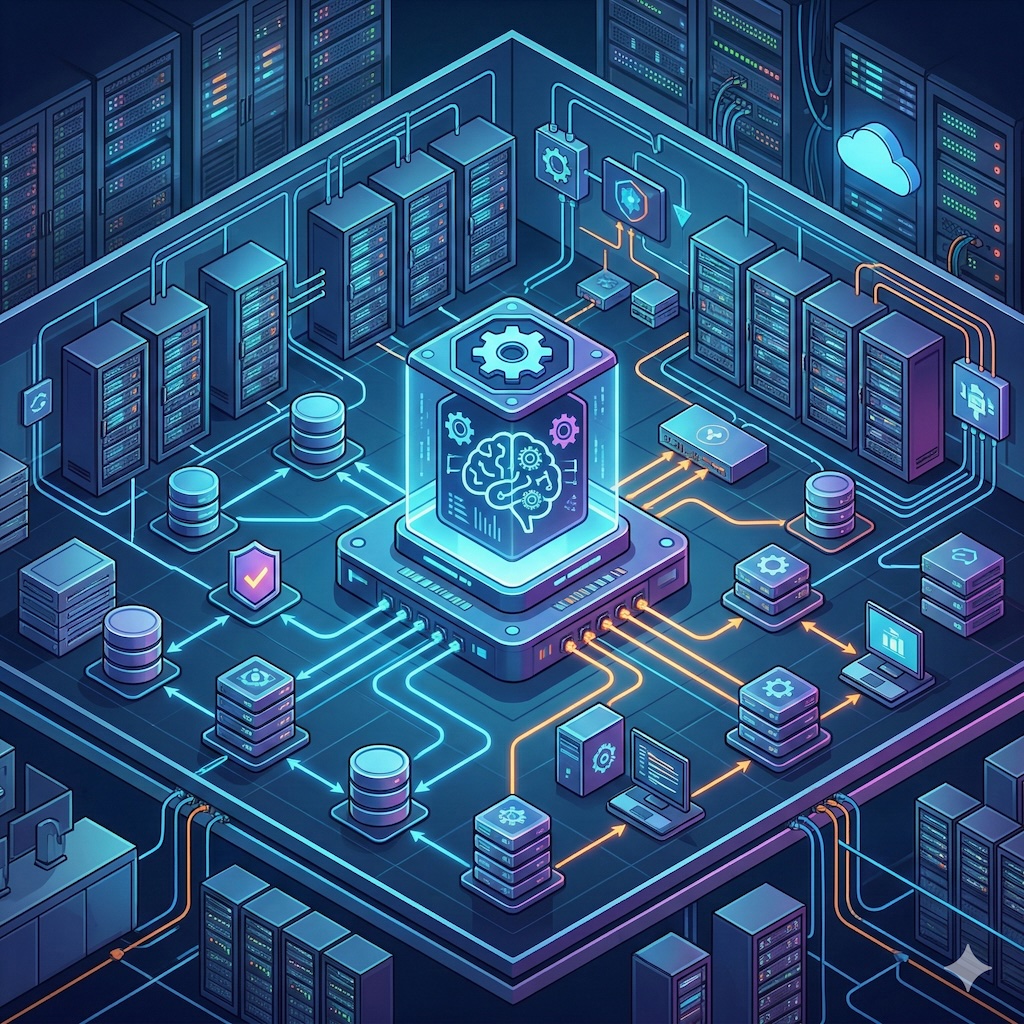

Déploiement dans un système d'information d'entreprise

Ollama n'est pas réservé aux postes individuels. Il se déploie également sur des serveurs partagés, accessibles à l'ensemble des collaborateurs via le réseau interne :

Architecture typique

- Un serveur dédié (physique ou VM) avec un GPU ou suffisamment de RAM, sur lequel Ollama tourne en tant que service système.

- Une interface web comme Open WebUI (anciennement Ollama WebUI) déployée en conteneur Docker, qui offre une interface comparable à ChatGPT accessible depuis le navigateur de chaque collaborateur.

- Une connexion aux sources de données internes via une architecture RAG : les documents de l'organisation (procédures, notes internes, bases de connaissance) sont indexés sous forme de vecteurs, et le modèle peut y puiser pour répondre avec des informations contextualisées.

Intégration applicative

L'API compatible OpenAI d'Ollama s'intègre nativement avec les bibliothèques les plus utilisées :

- LangChain et LlamaIndex : frameworks d'orchestration IA qui supportent Ollama comme backend d'inférence.

- n8n et Make : outils d'automatisation no-code qui proposent des nœuds Ollama pour intégrer l'IA dans des workflows.

- Continue.dev : extension VS Code qui utilise Ollama pour proposer une assistance au code similaire à GitHub Copilot, entièrement locale.

Prérequis matériels : ce qu'il faut réellement

L'un des freins perçus à l'IA locale est la crainte de devoir investir dans du matériel onéreux. La réalité est plus nuancée :

- Modèles 7B quantifiés (Q4) : fonctionnent sur un ordinateur équipé de 8 Go de RAM. Les performances sont correctes pour des usages bureautiques (rédaction assistée, résumé, Q&R).

- Modèles 7B-13B avec bon confort d'utilisation : 16 Go de RAM, idéalement avec un GPU dédié (même une RTX 3060 avec 12 Go de VRAM est suffisante). Le GPU accélère l'inférence de façon significative.

- Modèles 70B pour des performances proches des services cloud : nécessitent 64 Go de RAM ou plus, ou un GPU professionnel (A100, RTX 4090). C'est le niveau du serveur dédié en salle machine.

- Apple Silicon (M1/M2/M3) : les MacBook Pro et Mac Studio sont particulièrement adaptés à Ollama grâce à leur mémoire unifiée — un M2 Pro avec 32 Go fait tourner des modèles 30B avec des performances excellentes.

Quand cela fait sens de déployer de l'IA en local

- Données confidentielles ou sensibles : toute organisation pour laquelle envoyer des données vers un LLM cloud pose des problèmes juridiques ou de conformité.

- Volumes de requêtes importants : au-delà d'un certain seuil d'utilisation, le coût mensuel des APIs cloud dépasse celui d'un serveur dédié amorti sur deux ans.

- Indépendance vis-à-vis des fournisseurs : pas de risque de hausse tarifaire, de coupure de service ou de modification des conditions d'utilisation.

- Personnalisation fine du modèle : Ollama permet de créer des Modelfiles qui définissent un système de prompt, une personnalité ou des instructions permanentes — l'équivalent d'un assistant IA configuré sur mesure pour l'organisation.

- Environnements déconnectés ou sensibles : réseaux classifiés, environnements industriels isolés, zones géographiques avec connectivité limitée.

L'IA locale n'est plus une curiosité de laboratoire. Avec des outils comme Ollama, elle est devenue une option opérationnelle, déployable en quelques heures par une équipe technique de taille modeste, sur du matériel existant ou peu coûteux. Pour les organisations qui hésitent à confier leurs données aux grands modèles cloud, c'est une voie de souveraineté numérique concrète et accessible.